본 논문은 2024 CVPR 에 게재된 논문이다.

목차

- Abstract

- Introduction

- Related Work

- Monocular Depth Estimation

- Physical Adversarial Attacks

- Methodology

- Problem Definition

- Generating Adversarial Texture

- Experiments

- Implementation Details

- Main Results

- Ablation Study

- Conclusion

Abstract

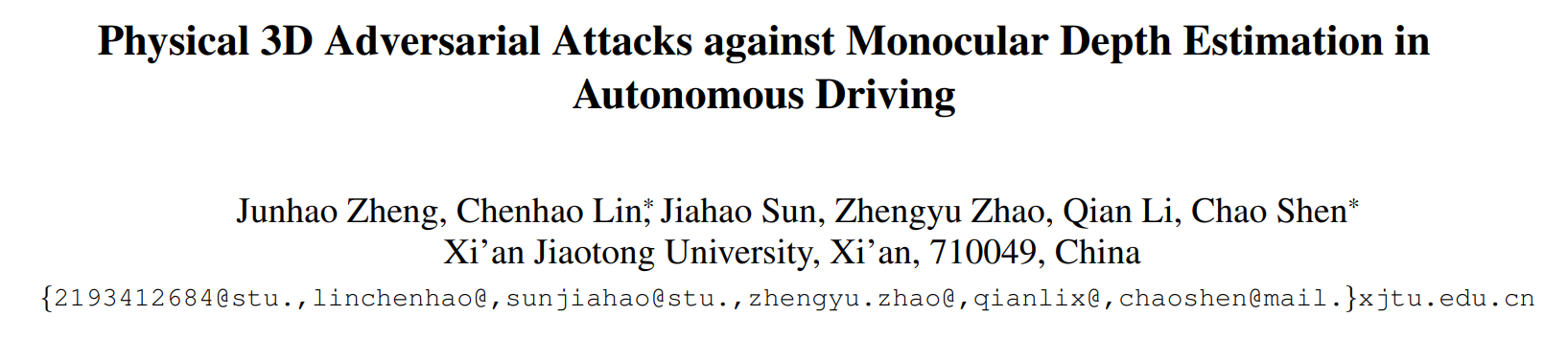

딥러닝 기반의 단안 깊이 추정(Monocular Depth Estimation, MDE)은 자율 주행에 광범위하게 적용되고 있으며, 적대적 공격에 취약한 것으로 알려져 있다. 기존의 MDE 모델에 대한 물리적 공격은 2D 적대적 패치에 의존하므로, MDE 맵에서 작고 국지적인 영역에만 영향을 미치고 다양한 시점에서 실패한다. 이러한 한계를 해결하기 위해, 본 논문은 MDE 모델에 대한 최초의 3D 텍스처 기반 적대적 공격인 3D Depth Fool ($3D^2$Fool)을 제안한다.

$3D^2$Fool 은 차량 모델 유형에 구애받지 않고 비, 안개와 같은 악천후 조건에서 향상된 견고성을 갖도록 3D 적대적 텍스처를 생성하도록 최적화되었다. 실험 결과는 차량, MDE 모델, 날씨 조건 및 시점을 포함한 다양한 시나리오에서 $3D^2$Fool의 우수한 성능을 입증한다.

실제 차량 모델에 인쇄된 3D 텍스처를 사용한 실제 실험은 $3D^2$Fool이 10미터가 넘는 MDE 오류를 유발할 수 있음을 보여준다.

코드는 https://github.com/Gandolfczjh/3D2Fool 에서 확인할 수 있다.

1. Introduction

단안 깊이 추정(Monocular Depth Estimation, MDE), 즉 이미지에서 카메라로부터 각 픽셀까지의 거리를 예측하는 것은 컴퓨터 비전의 핵심 작업이다. 이 기술은 로봇 내비게이션 [9, 10, 31] 및 자율 주행 [25]과 같은 실제 시나리오에서 광범위하게 사용된다.

최근 연구들은 MDE[7, 8, 16, 17, 40, 42]가 적대적 공격에 취약하다는 것을 입증했다. 적대적 공격에는 디지털 공격 [6, 15, 43, 45, 46]과 물리적 공격 [5, 32–34, 36, 37, 41, 44]의 두 가지 주요 유형이 있다. 디지털 공격은 이미지 픽셀에 작은 노이즈를 추가하는 것을 포함하며, 인쇄, 날씨 조건 및 시점 변화 [32]와 같은 물리적 변환에 대한 민감성 때문에 그 성공을 물리적 세계로 직접 변환하기 어렵다. 물리적 공격은 다양한 물리적 제약 조건 하에서 노이즈를 최적화하여 이러한 제한 사항을 해결하며, 실제 자율 주행 시스템을 오도하는 데 성공했다 [32, 33, 36, 37, 44].

물리적 세계 공격에서 공격자는 2D 적대적 패치 [5, 13, 34] 또는 3D 위장 텍스처 [32, 33, 36, 37, 44]를 설계하고 이를 대상 차량에 붙여 카메라에 캡처된 다음 피해자 모델에 공급한다.

2D 적대적 패치는 객체 표면의 작은 국소 평면 부분에만 붙여지므로 다른 시야각과 거리에서 적대적 효과를 달성하지 못한다.

대조적으로, 3D 위장 텍스처가 차량 전체 표면을 덮도록 제작되어, 시점에 관계없이 더 나은 공격 성능을 이끌어낸다.

그러나 자율 주행에서의 기존 물리적 세계 공격은 주로 객체 탐지 [32, 33]에 집중되어 왔으며, MDE에 대한 연구는 거의 없었다. 게다가, MDE에 대한 기존의 모든 공격은 2차원 adversarial patch [8, 16, 17, 42]에 기반하고 있으며, 이는 다양한 각도와 거리의 까다로운 조건에서 불가피하게 제한된다. 본 연구에서는 MDE 모델에 대한 최초의 3차원 adversarial 위장 공격인 3D Depth Fool ($3D^2$Fool) 을 제안한다. 이는 시점 변화에 관계없이 광범위한 대상 차량에 적용 가능한 강력한 위장 텍스처를 생성한다. 게다가, 객체 탐지에 대한 유사한 연구를 넘어, 악천후에서의 공격 성능을 향상시키기 위해 공격 최적화 중에 기상 조건을 시뮬레이션한다.

$3D^2$Fool 의 최적화는 텍스처 변환(TC)과 물리적 증강(PA)의 두 가지 주요 모듈로 구성된다.

(1) TC는 2차원 adversarial 텍스처 시드를 차량의 전체 표면에 붙여넣은 3차원 위장 텍스처로 변환한다. 특히, TC는 객체 특정 UV map에 독립적이므로 자동차, 버스, 심지어 보행자와 같은 다양한 유형의 대상 객체에 직접 적용할 수 있다. 3D 자동차나 사람 같은 물체에 그림(텍스처)을 입힐 때, 보통 그 물체마다 특별한 설계도 같은 게 필요하다. 이걸 UV 맵이라고 부른다. UV 맵은 물체 모양에 맞게 그림을 어떻게 붙일지 알려주는 지도 같은 것이다. 그런데 물체마다 모양이 다르니까, 다른 설계도를 써야 해서 다른 그림을 만들어야 하는 번거로움이 있다. 이 논문에서 말하는 TC는 그런 물체별 설계도, 즉 UV 맵을 안 써도 된다는 의미이다. 그래서 한 번 만든 그림(2D adversarial texture seed)을 자동차든 버스든 심지어 사람 모양에도 똑같이 붙일 수 있다.

(2) PA는 렌더링된 3차원 차량(텍스처 포함)을 다양한 장면에 배치하여 사실적인 이미지를 얻는다.

특히, 극심한 밝기 및 안개와 같은 다양한 기상 조건을 시뮬레이션하기 위해 노이즈를 추가하고 로컬 이미지 영역을 교란한다. 이는 악천후에서 $3D^2$Fool 의 견고성을 향상시킨다. 아래 Figure 1은 3D 텍스처 기반 $3D^2$Fool이 공격을 받는 차량을 MDE map에서 완전히 사라지게 만드는 반면, 다른 2차원 patch 기반 방법은 차량의 작은 영역에만 영향을 미친다는 것을 보여준다.

본 논문의 주요 기여는 아래와 같다.

- MDE 모델에 대한 최초의 3차원 adversarial 위장 공격인 3D Depth Fool ($3D^2$Fool)을 제안한다.3D2Fool은 시점 변화와 같은 다양한 물리적 제약 조건 하에서 광범위한 대상 차량(심지어 보행자)에 적용될 수 있다.

- 차량 특정 UV map에 독립적인 2차원 adversarial 텍스처 시드를 최적화하여 객체에 구애받지 않는 3차원 위장 텍스처를 생성하기 위해 $3D^2$Fool 에서 텍스처 변환이라는 새로운 모듈을 설계한다.

- 공격 최적화에 날씨 관련 데이터 증강을 통합하여 다양한 기상 조건에서 3D2Fool의 견고성을 향상시키기 위해 $3D^2$Fool 에서 물리적 증강이라는 새로운 모듈을 설계한다.

2. Related Work

2.1. Monocular Depth Estimation

Monocular depth estimation (MDE)은 2차원 이미지에서 환경 정보를 인식하는 데 중요한 역할을 한다. Eigen et al. [12]은 깊이 추정을 예측하기 위해 딥 뉴럴 네트워크를 처음으로 활용했다. Monodepth2 [14]는 self-supervised learning 및 multi-scale loss function을 통해 성능을 크게 향상시켰다. RobustDepth [29]는 다양한 기상 조건을 시뮬레이션하기 위해 데이터 증강을 사용하여 MDE의 견고성과 성능을 향상시켰다. 본 연구에서는 널리 사용되는 다양한 MDE 방법에 효과적인 것으로 나타난 새로운 공격인 $3D^2$Fool을 제안한다.

2.2. Physical Adversarial Attack

물리적 adversarial 공격은 광범위하게 연구되었다. 기존 연구 [5, 13, 23, 24, 34]는 디지털 공간 제약 조건만 있는 adversarial patch에 의존하여 복잡한 물리적 세계에서 효과적인 공격을 달성하기 어렵다. 이후 연구 [32, 33, 36, 37, 44]에서는 차량의 비평면 표면에 텍스처를 페인팅하여 견고성을 향상시키기 위해 3차원 텍스처 기반 공격을 제안한다. 특히, Dual Attention Suppression (DAS) [37]은 미분 가능한 렌더링 [18]을 기반으로 모델과 인간의 attention을 모두 억제한다. Differentiable Transformation Attack (DTA) [32]는 다양한 실제 특성과 복잡한 장면을 반영하기 위해 새로운 미분 가능한 변환 네트워크를 설계한다.

- Physical adversarial attacks against MDE

- MDE 공격에 대한 초기 연구 [7, 40]는 물리적 세계에서 효과가 없는 것으로 알려진 기존의 이미지 수준의 교란에 의존한다. 최근 연구 [8, 16]에서는 인쇄 가능한 adversarial patch에 의존하여 이를 개선한다. 특히, Stealthy and Physical-Object-Oriented (SPOO) [8]는 patch를 작게 제한하고 style transfer [22]을 활용하여 은밀성을 더욱 향상시킨다. Adaptive Adversarial (APARATE)은 추정된 거리를 손상시키고 객체를 사라지게 하여 MDE를 선택적으로 속인다. 2차원 patch 기반 공격과 달리, 본 논문의 공격인 $3D^2$Fool은 MDE에 대한 최초의 3차원 텍스처 기반 공격으로, 다양한 시점 변화에서 최첨단 공격 성능을 제공한다. 또한, $3D^2$Fool은 날씨 변화에 강하고 여러 대상 차량에 적용할 수 있도록 설계되었다.

3. Methodology

3.1. Problem definition

본 논문에서 연구진들이 해결해야 할 문제는 비, 안개 등 다양한 날씨에서 시점에 관계없이 물리적 세계에서 MDE를 공격하기 위해 adversarial 텍스처로 차량 전체 표면을 덮는 것이다.

Adversarial 위장 공격을 실현하기 위해 2차원 adversarial 텍스처 시드 $t_s$를 전체 위장 텍스처로 반복하여 차량 표면에 페인트한다. 다시 말해서, 2D adversarial texture seed란 일종의 작은 패턴 이미지 조각이다. 이것은 표면에 입힐 기본 텍스쳐의 핵심 단위라고 볼 수 있다. 이 작은 패턴을 그냥 한 번만 차량에 붙이는 것이 아니라, 차량의 전체 표면을 덮을 수 있도록 여러 번 반복해서 붙인다. 즉, 패턴을 여러 개 이어 붙여 큰 텍스쳐 하나를 만드는 것이 되겠다.

시드를 다양한 종류의 객체에 적합하게 만들기 위해 텍스처 변환 TC (3.2절에서 소개)를 사용하여 객체 특정 UV map의 영향을 제거한다. 다음과 같이 최종 2차원 adversarial 텍스처 $t_{adv}$를 계산할 수 있다:

$$t_{adv} = TC(t_s) \quad(1)$$

다음으로, 3D 객체 O의 표면에 적대적 텍스처를 적용하고 미분 가능한 렌더러(R) [18]를 사용하여 위장된 2D 차량 이미지에 투영한다. 그런 다음 자연스러운 밝기와 날씨 조건을 모방하여 물리적 증강 PA(3.2절에서 소개)를 통해 적대적 이미지 $x_{adv}$를 얻을 수 있다. 적대적 이미지는 다음과 같이 표현된다:

$$

x_{\text{adv}} = \text{PA}(\text{R}(t_{\text{adv}}, O; \theta_c), b, m)

$$

여기서 $\theta_c$는 렌더링에 필요한 카메라 매개변수(즉, 변환 및 위치)이고, $b$는 도로 배경 이미지이며, $m$은 시나리오의 객체 마스크이다. 여기서 $R(t_{adv}, O; \theta_c)$가 바로 위장된 2D 차량 이미지 $O_{adv}$이며, PA가 적용된 후 $x_{adv}$가 되는 것이다.

$\text{D}(\cdot)$는 단안 깊이 추정 모델의 가설 함수이고, $x$는 차량이 양성이거나 적대적인 텍스처를 가질 수 있는 2D 이미지 입력을 나타낸다. 예측 $d = \text{D}(x)$를 얻을 수 있으며, 여기서 출력으로서의 $d$는 깊이 추정 맵을 나타낸다.

제안된 방법의 목표는 목표 차량의 표면 텍스처를 수정하여 시각적으로 차량을 사라지게 만들어 MDE가 목표 차량의 깊이를 잘못 예측하도록 만드는 것이며, 이는 $dt = \text{D}(x_{adv})$를 만족한다. dt라는 개념은 MDE가 예측할 것으로 예상하는 목표 깊이를 나타내고, $x_{adv}$는 목표 차량이 적대적 텍스처로 덮여 있는 2D 이미지를 나타낸다. $\text{L}(\text{D}(x), d)$가 입력 이미지 $x$의 깊이 추정값을 $d$에 가깝게 만드는 $\text{D}(\cdot)$에 적용되는 손실 함수라고 가정한다.

따라서 궁극적으로 방정식 (3)을 풀어 적대적 텍스처 시드를 얻을 수 있다. $t_s = \text{arg min L}(\text{D}(x_{adv}), d_t) \quad(3) $

3.2. Generating Adversarial Texture

강력하고 효과적인 적대적 텍스처를 생성하기 위해 그림 2에 설명된 3D 적대적 위장 공격 프레임워크를 제안한다.

훈련 세트 (B, M, Θc)는 사진처럼 사실적인 시뮬레이터인 Carla [11]에서 다양한 카메라 매개변수 및 환경 설정에서 샘플링된다.

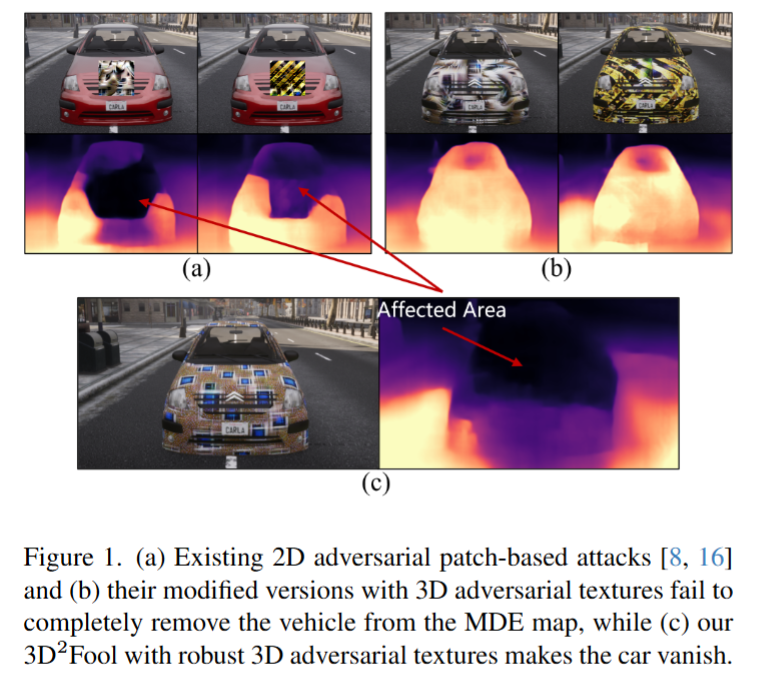

$3D^2$Fool은 먼저 적대적 텍스처 시드 $t_s$를 새로운 텍스처 변환 (TC) 모듈을 통해 적대적 텍스처 $t_{adv}$로 변환한다.

그런 다음 동일한 카메라 매개변수로 위장 텍스처를 차량 표면에 렌더링하여 위장된 2D 차량 $O_{adv}$를 얻는다. 다음으로 새로운 물리적 증강 (PA) 모듈을 통해 위장된 차량을 다양한 물리적 시나리오로 전송한다. 적대적 텍스처 시드는 총 손실 함수 Ltotal(아래 소개)를 사용하여 역전파를 통해 최적화된다.

- Texture Conversion (TC)

- 텍스처 UV 맵은 차량마다 특화되어 있으므로 위장 공격을 다른 차량에 직접 적용하기 어렵다. [32]에서 영감을 받아 적대적 텍스처 시드를 반복적인 방식으로 차량 텍스처로 변환하는 텍스처 변환 (TC)을 제안하며, 이는 객체에 구애받지 않는 적대적 텍스처를 생성하는 데 유용하다.

- [32]의 반복적인 텍스처 투영과는 달리, 대상 차량의 투영과 동일한 카메라 포즈를 기반으로 반복 패턴을 3D 뷰로 변환하기 위해 3D 회전 연산을 사용하므로 자동차 표면의 원래 세부 사항이 손실된다. 따라서 표면 세부 사항을 시뮬레이션하기 위해 DTN(Differential Transformation Network) [32]이 사용된다. 대조적으로 적대적 텍스처를 붙여넣을 수 있는 영역을 조정할 수 있으며 왜곡 없이 정확하게 렌더링된 2D 차량 텍스처를 얻기 위해 미분 가능한 렌더러 [18]를 사용하기만 하면 된다.

- 변환 프로세스는 아래 Figure 3에 나와 있다. $t_s$로 $n \times n$ 적대적 텍스처 시드를 정의한다. 먼저 회전, 뒤집기 등과 같은 다양한 임의 변환을 추가하여 적대적 텍스처의 견고성을 향상시킨다. 그런 다음 변환된 텍스처 시드를 $\tau n \times \tau n$ 크기로 확대한다. 여기서 $\tau$는 배율을 나타내고, 가장자리에 여러 텍스처 시드를 연결한다.객체 특정 텍스처 UV 맵의 영향을 막기 위해, 랜덤 클리핑을 사용하여 최종 텍스처를 얻고, 이는 마스크를 통해 대상 차량을 덮기 위해 원래 텍스처를 직접 대체할 수 있다. 위의 변환은 다음 방정식 (4)로 표현할 수 있다:

$t_{\text{adv}} = \text{RC}(M_{\text{repeat}} \cdot M_{\text{robust}} \cdot t_s) \quad(4) $

여기서 $\text{Mrobust}$는 랜덤 변환의 구성을 나타내는 행렬이고, $\text{Mrepeat}$는 반복 연산이며, $\text{RC}(\cdot)$는 텍스처를 지정된 크기 $N \times N$으로 자르는 랜덤 클리핑 함수이다.

- Physical Augmentation

- Expectation over Transformation (EoT) [4]는 악천후 조건의 영향을 막기에는 충분하지 않다. 날씨 렌더링 변환(예: [27, 35])에서 영감을 받아, 시뮬레이션과 물리적 환경 간의 간극을 메우고 다양한 날씨 조건에서 공격 견고성을 향상시키기 위해 Physical Augmentation (PA)을 제안한다. 구체적으로, 노출, 그림자, 빗소리, 안개 소음과 같은 데이터 증강 섭동을 2D 렌더링된 차량 이미지 $O_{adv}$에 추가한다. Automold [3]를 참조하여, 노출 또는 그림자 마스크를 생성하기 위해 다항식 모델을 사용하고 자연스러움을 위해 경계를 부드럽게 하기 위해 Gaussian blur를 활용한다. $\theta_b$를 노출 또는 그림자가 배치된 픽셀 영역이라고 하고, 각 픽셀 강도를 수정하여 자연 조명의 효과를 시뮬레이션한다. 물리 기반 렌더러 (PBR) [35]와 유사하게, 깊이 맵의 사전 정보를 활용하여 현실적인 비 및 안개 증강을 생성한다. $\theta_r$ 및 $\theta_f$를 픽셀 단위의 비 및 안개 노이즈 행렬이라고 한다. 마지막으로, 채도 등에서 렌더링된 텍스처를 무작위로 변환하여 EoT를 적용하며, EoT(·)로 표현된다. 따라서 PA는 다음 방정식 (5)로 요약할 수 있다:

$O_{\text{adv-p}} = \text{EoT}(\theta_b \odot O_{\text{adv}} + \theta_r + \theta_f) \quad(5) $

- 여기서 $O_{adv-p}$는 PA 후의 적대적 2D 텍스처이며, 마스크 m을 통해 훈련 세트의 자연스러운 시나리오에 직접 배치할 수 있다. 다음 방정식 (6)으로 최종 적대적 이미지를 얻을 수 있다:

$x_{\text{adv}} = b \odot (1 - m) + O_{\text{adv\_p}} \odot m \quad(6) $

- 여기서 $O_{adv-p}$는 PA 후의 적대적 2D 텍스처이며, 마스크 m을 통해 훈련 세트의 자연스러운 시나리오에 직접 배치할 수 있다. 다음 방정식 (6)으로 최종 적대적 이미지를 얻을 수 있다:

- Expectation over Transformation (EoT) [4]는 악천후 조건의 영향을 막기에는 충분하지 않다. 날씨 렌더링 변환(예: [27, 35])에서 영감을 받아, 시뮬레이션과 물리적 환경 간의 간극을 메우고 다양한 날씨 조건에서 공격 견고성을 향상시키기 위해 Physical Augmentation (PA)을 제안한다. 구체적으로, 노출, 그림자, 빗소리, 안개 소음과 같은 데이터 증강 섭동을 2D 렌더링된 차량 이미지 $O_{adv}$에 추가한다. Automold [3]를 참조하여, 노출 또는 그림자 마스크를 생성하기 위해 다항식 모델을 사용하고 자연스러움을 위해 경계를 부드럽게 하기 위해 Gaussian blur를 활용한다. $\theta_b$를 노출 또는 그림자가 배치된 픽셀 영역이라고 하고, 각 픽셀 강도를 수정하여 자연 조명의 효과를 시뮬레이션한다. 물리 기반 렌더러 (PBR) [35]와 유사하게, 깊이 맵의 사전 정보를 활용하여 현실적인 비 및 안개 증강을 생성한다. $\theta_r$ 및 $\theta_f$를 픽셀 단위의 비 및 안개 노이즈 행렬이라고 한다. 마지막으로, 채도 등에서 렌더링된 텍스처를 무작위로 변환하여 EoT를 적용하며, EoT(·)로 표현된다. 따라서 PA는 다음 방정식 (5)로 요약할 수 있다:

- Vehicle Vanishing Loss

- 본 논문의 목표는 적대적 텍스처가 있는 차량이 MDE의 관점에서 사라지게 하는 것, 즉 깊이 추정 맵이 대상 차량 영역에서 잘못되도록 하는 것이다. 적대적 패치로 MDE를 공격하는 이전 연구에서, 마스크는 일반적으로 객체 영역을 덮고 예측 깊이와 대상 깊이 사이의 평균 제곱 오차를 손실 함수로 계산하는 데 사용되었다. 이전 방법으로 얻은 패치는 대상 차량의 일부에만 성공적으로 영향을 미칠 수 있으며, 전체 객체를 사라지게 하기에는 충분하지 않다는 것을 관찰했다. 이러한 제한을 극복하기 위해 대상 차량의 전체 표면에 적대적 텍스처를 덮는다. 본 논문의 손실 함수는 다음과 같다:

$L_a = \text{MSE}(D(x_{\text{adv}})^{-1} \odot m, 0) \quad (7) $

- 여기서 MSE(·, ·)는 두 변수 사이의 평균 제곱 오차이고, 마스크 m은 대상 차량의 전체 영역을 덮는다. 본 논문의 목표는 $L_a$를 최소화하여 적대적 텍스처 시드를 최적화하는 것이다.

- 본 논문의 목표는 적대적 텍스처가 있는 차량이 MDE의 관점에서 사라지게 하는 것, 즉 깊이 추정 맵이 대상 차량 영역에서 잘못되도록 하는 것이다. 적대적 패치로 MDE를 공격하는 이전 연구에서, 마스크는 일반적으로 객체 영역을 덮고 예측 깊이와 대상 깊이 사이의 평균 제곱 오차를 손실 함수로 계산하는 데 사용되었다. 이전 방법으로 얻은 패치는 대상 차량의 일부에만 성공적으로 영향을 미칠 수 있으며, 전체 객체를 사라지게 하기에는 충분하지 않다는 것을 관찰했다. 이러한 제한을 극복하기 위해 대상 차량의 전체 표면에 적대적 텍스처를 덮는다. 본 논문의 손실 함수는 다음과 같다:

- Smooth Loss

- 생성된 적대적 텍스처 시드의 자연스러움을 보장하기 위해, 인접한 픽셀 간의 불일치를 줄이기 위해 smooth loss (즉, Total Variation loss [26])를 활용한다. 적대적 텍스처 시드 $t_s$의 경우, smooth loss는 다음과 같이 계산할 수 있다:

$L_{st} = \sum_{i,j} \sqrt{(t_s^{i,j} - t_s^{i+1,j})^2 + (t_s^{i,j} - t_s^{i,j+1})^2} \quad(8)$

- 여기서 $t _s^{i,j}$는 좌표 (i, j)에서 $t_s$의 픽셀 값이다.

- 생성된 적대적 텍스처 시드의 자연스러움을 보장하기 위해, 인접한 픽셀 간의 불일치를 줄이기 위해 smooth loss (즉, Total Variation loss [26])를 활용한다. 적대적 텍스처 시드 $t_s$의 경우, smooth loss는 다음과 같이 계산할 수 있다:

- NPS Loss

- 물리적 세계에서 MDE를 공격하려면 프린터에 의한 적대적 텍스처 시드의 인쇄 가능성이 필요하다. 객체 텍스처 색상 세트를 규제하기 위해 Non-Printability Score (NPS) [30] loss를 활용합니다. 한편, 은밀성을 고려하여 10가지 색상만 무작위로 선택합니다. 적대적 텍스처 시드 $t_s$의 경우, NPS loss는 다음과 같이 계산할 수 있다:

$L_{\text{nps}} = \frac{1}{n \times n} \sum_{i,j} \min_{c \in C} |c - t_s^{i,j}| \quad (9) $- 여기서 n은 스케일 팩터로서 텍스처 시드의 변 길이이고 C는 객체 텍스처 색상 세트이다. 마지막으로, 총 손실 $L_{\text{total}}$은 다음 방정식 (10)으로 구성된다:

$L_{\text{total}} = L_a + \alpha L_{\text{st}} + \beta L_{\text{nps}} \quad (10) $- 여기서 α와 β는 각 손실 함수의 기여도를 제어하는 가중치이다. 알고리즘 1은 MDE 모델에 대한 $3D^2$Fool 을 요약한다.

- 여기서 α와 β는 각 손실 함수의 기여도를 제어하는 가중치이다. 알고리즘 1은 MDE 모델에 대한 $3D^2$Fool 을 요약한다.

- 여기서 n은 스케일 팩터로서 텍스처 시드의 변 길이이고 C는 객체 텍스처 색상 세트이다. 마지막으로, 총 손실 $L_{\text{total}}$은 다음 방정식 (10)으로 구성된다:

- 물리적 세계에서 MDE를 공격하려면 프린터에 의한 적대적 텍스처 시드의 인쇄 가능성이 필요하다. 객체 텍스처 색상 세트를 규제하기 위해 Non-Printability Score (NPS) [30] loss를 활용합니다. 한편, 은밀성을 고려하여 10가지 색상만 무작위로 선택합니다. 적대적 텍스처 시드 $t_s$의 경우, NPS loss는 다음과 같이 계산할 수 있다:

4. Experiments

이 섹션에서는 먼저 실험 설정을 설명한다. 그런 다음 제안된 방법의 성능을 여러 측면에서 조사하고 이전 연구와 비교하기 위해 포괄적인 실험을 수행한다.

4.1. Implementation Details

- MDE Model Selection

- 본 실험에서는 Monodepth2 [14], Depthhints [38], Manydepth [39], 그리고 Robustdepth [29]의 네 가지 MDE 모델을 사용한다. 처음 세 모델은 [8]을 참고하여 선택되었고, Robustdepth는 악천후에 대한 견고성 때문에 선택되었다.

- Datasets

- 적대적 텍스처 훈련을 위해, 무작위로 210개의 스폰 위치를 선택하고 다양한 날씨 환경에서 도시 도로, 고속도로, 시골 도로 등을 포함하는 Carla [11]로부터 배경 사진을 캡처한다. 차량을 배치하는 데 사용되는 위치의 경우, Carla에서 RGB 카메라 센서를 사용하여 0-360◦의 무작위 각도와 3-15m의 거리 범위 내에서 8400개의 이미지를 촬영한다.

공격 평가를 위해, Unreal Engine 의 월드 정렬 텍스처 기능(https://dev.epicgames.com/community/learning/courses/D5Z/unreal-engine-d3b79e/GyMx/unreal-engine-2abef0)을 통해 생성된 적대적 텍스처를 네 종류의 차량과 버스 및 보행자와 같은 자율 주행 시나리오에서 흔히 볼 수 있는 다른 객체에 오버레이하고 각 차량의 특정 텍스처 UV 맵을 무시하고 총 6124개의 이미지를 수집한다. 카메라 위치는 훈련 세트와 동일한 방식으로 선택된다. 또한, 악천후에서의 공격 성능을 평가하기 위해 안개, 비, 맑음, 흐림의 네 가지 날씨를 선택한다. 실제 환경에서의 실험을 위해 실제 차량 대신 Tesla 자동차 모델을 사용한다.

- 적대적 텍스처 훈련을 위해, 무작위로 210개의 스폰 위치를 선택하고 다양한 날씨 환경에서 도시 도로, 고속도로, 시골 도로 등을 포함하는 Carla [11]로부터 배경 사진을 캡처한다. 차량을 배치하는 데 사용되는 위치의 경우, Carla에서 RGB 카메라 센서를 사용하여 0-360◦의 무작위 각도와 3-15m의 거리 범위 내에서 8400개의 이미지를 촬영한다.

- Evaluation Metrics

- 제안된 공격의 성능을 평가하기 위해 대상 객체의 평균 깊이 추정 오류 $E_d$와 영향을 받는 영역의 비율 $R_a$ [8]을 사용한다. $E_d$는 적대적 차량과 정상 차량의 깊이 예측 간의 차이의 평균을 나타낸다. 클수록 성능이 좋으며, $R_a$ 지표도 마찬가지이다. 픽셀 위치의 깊이 추정 오류가 특정 임계값을 초과하면 공격이 성공한 것으로 간주된다. 따라서 $R_a$는 전체 대상 차량 영역에서 공격이 성공한 픽셀의 비율을 나타낸다. 차이 $\Delta{d} = |D(x_{adv}) − D(x_{benign})|$가 주어지면, $E_d$는 다음과 같이 표현할 수 있고, 영향을 받는 영역의 비율 $R_a$는 다음과 같이 나타낼 수 있다:

- $$E_d = \frac{\text{sum}(△d \odot m)}{\text{sum}(m)} \quad (11)$$

- $$R_a = \frac{\text{sum}(I(△d ⊙ m ≥ Vthre))}{\text{sum}(m)} \quad (12)$$

- 여기서 I(x)는 x가 참일 때만 1로 평가되는 indicator function이다. 본 논문의 연구진들은 임계값을 10으로 선택한다. 즉, 깊이 추정 오류가 10을 초과하면 공격이 성공한 것으로 간주되고 영향을 받는 영역이 계산된다.

- 제안된 공격의 성능을 평가하기 위해 대상 객체의 평균 깊이 추정 오류 $E_d$와 영향을 받는 영역의 비율 $R_a$ [8]을 사용한다. $E_d$는 적대적 차량과 정상 차량의 깊이 예측 간의 차이의 평균을 나타낸다. 클수록 성능이 좋으며, $R_a$ 지표도 마찬가지이다. 픽셀 위치의 깊이 추정 오류가 특정 임계값을 초과하면 공격이 성공한 것으로 간주된다. 따라서 $R_a$는 전체 대상 차량 영역에서 공격이 성공한 픽셀의 비율을 나타낸다. 차이 $\Delta{d} = |D(x_{adv}) − D(x_{benign})|$가 주어지면, $E_d$는 다음과 같이 표현할 수 있고, 영향을 받는 영역의 비율 $R_a$는 다음과 같이 나타낼 수 있다:

- Compared Methods

- 저희는 MDE 모델에 대한 물리적 도메인에서 이전 연구 [8, 16, 17, 42]와 적대적 위장 공격을 비교한다. SPOO [8] 및 APARATE [16]는 패치를 사용하여 대상 객체를 공격하는 객체 지향적 방법인 반면, Adversarial Patches Attack(APA) [42] 및 Stealthy Adversarial Attack (SAAM) [17]은 객체와 독립적으로 로컬 패치 영역에 영향을 미치는 패치 지향적 방법이다. 공정한 비교를 위해, 본 논문은 위의 방법을 훈련 세트에서 재훈련한 다음 생성된 패치와 무작위 색상 텍스처를 동일한 방식으로 대상 차량에 오버레이한다.

- 저희는 MDE 모델에 대한 물리적 도메인에서 이전 연구 [8, 16, 17, 42]와 적대적 위장 공격을 비교한다. SPOO [8] 및 APARATE [16]는 패치를 사용하여 대상 객체를 공격하는 객체 지향적 방법인 반면, Adversarial Patches Attack(APA) [42] 및 Stealthy Adversarial Attack (SAAM) [17]은 객체와 독립적으로 로컬 패치 영역에 영향을 미치는 패치 지향적 방법이다. 공정한 비교를 위해, 본 논문은 위의 방법을 훈련 세트에서 재훈련한 다음 생성된 패치와 무작위 색상 텍스처를 동일한 방식으로 대상 차량에 오버레이한다.

- Attack Parameters

- 본 논문의 적대적 텍스처는 10 epoch으로 Adam [19]을 사용하여 최적화된다. EoT의 경우, 0.2 무작위 밝기, [0.9, 1.1] 무작위 대비 등을 사용한다. 텍스처 변환의 경우, 무작위 수직 또는 수평 뒤집기와 0.5의 확률로 ±90◦ 회전을 사용한다.

확률. 저희는 적대적 패치 n의 초기 크기를 128, 반복 파라미터 τ = 6, 무작위 클리핑 후 크기 N = 512로 설정한다. loss 하이퍼파라미터의 경우, 기본적으로 α = 0.1, β = 5를 사용한다.

- 본 논문의 적대적 텍스처는 10 epoch으로 Adam [19]을 사용하여 최적화된다. EoT의 경우, 0.2 무작위 밝기, [0.9, 1.1] 무작위 대비 등을 사용한다. 텍스처 변환의 경우, 무작위 수직 또는 수평 뒤집기와 0.5의 확률로 ±90◦ 회전을 사용한다.

4.2. Main Results

- Attack Effectiveness

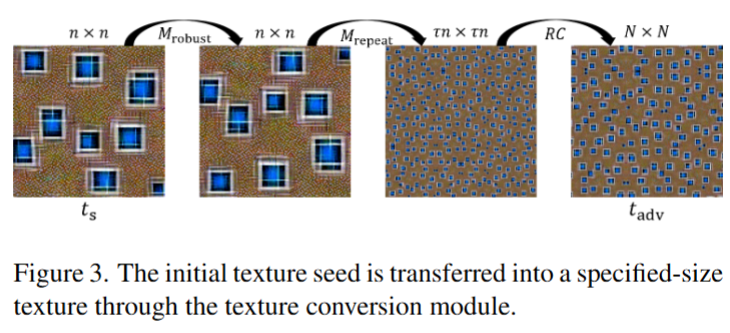

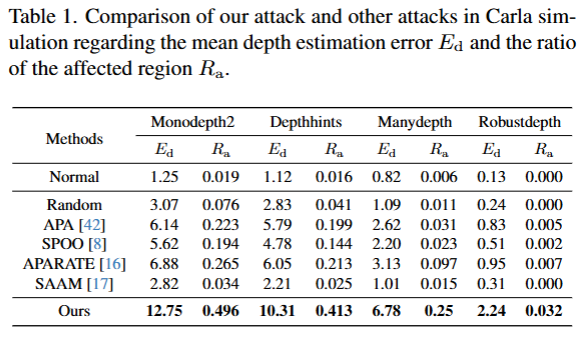

- 본 논문은 네 가지 MDE 모델에서 적대적 위장 공격과 이전 공격 방법을 실행하고 각 모델에 대해 네 가지 유형의 차량을 대상으로 한다. 각 유형의 차량에 대해 특정 텍스처 UV 맵 대신 월드 정렬 텍스처 [33]를 표면에 적용한다. 그런 다음 위의 네 가지 MDE 모델을 사용하여 적대적 텍스처가 있는 대상 차량의 깊이를 예측하여 성능을 평가한다. 아래 Table 1에서 보듯이, 본 논문의 방법은 모든 모델에서 일관되게 최고의 공격 성능을 보인다.

전체 텍스처 커버리지 테스트에서 패치 지향적 방법과 객체 지향적 방법은 유사한 효과를 달성한다. 그중 SPOO는 자연스러운 외관을 위해 노력했지만, 전체 텍스처 커버리지 시에는 자연스러움(stealthiness) 측면에서 성능 저하가 발생했고, 생성된 패치를 차량 표면에 붙여 위장 공격을 하면 패치의 왜곡 및 변형으로 인해 공격 성능이 더 떨어지는 문제가 관찰되었다. 원래 논문에 제시된 패치 공격 방법과 비교하여 생성된 패치를 차량 표면에 붙여서 위장 공격을 하면 결과가 더 나빠진다. 이전 접근 방식의 복잡한 날씨 조건에 대한 부적절한 적응성 외에도 패치의 뒤틀림과 변형으로 인해 상당한 저하가 발생한다. 대조적으로, 본 논문의 방법은 제안된 텍스처 변환 덕분에 텍스처 시드에서 위장 텍스처까지 공격 성능을 유지한다. 위의 Figure 4에서 볼 수 있듯이, 본 논문의 적대적 공격은 거의 전체 목표 차량의 깊이 추정에 영향을 미쳐 MDE 모델의 관점에서 효과적으로 사라지게 만든다.

다양한 모델에 대한 공격 성능에 있어서, Monodepth2와 Depthhints 모두 적대적 공격에 상당한 취약성을 보이는 반면, Robustdepth는 네 가지 MDE 모델 중에서 가장 강력한 것으로 나타났다. 이는 Robustdepth가 훈련 단계에서 악천후 조건을 시뮬레이션하기 위해 데이터 증강을 적용하기 때문에 이해할 수 있다.

- 본 논문은 네 가지 MDE 모델에서 적대적 위장 공격과 이전 공격 방법을 실행하고 각 모델에 대해 네 가지 유형의 차량을 대상으로 한다. 각 유형의 차량에 대해 특정 텍스처 UV 맵 대신 월드 정렬 텍스처 [33]를 표면에 적용한다. 그런 다음 위의 네 가지 MDE 모델을 사용하여 적대적 텍스처가 있는 대상 차량의 깊이를 예측하여 성능을 평가한다. 아래 Table 1에서 보듯이, 본 논문의 방법은 모든 모델에서 일관되게 최고의 공격 성능을 보인다.

- Attack Robustness

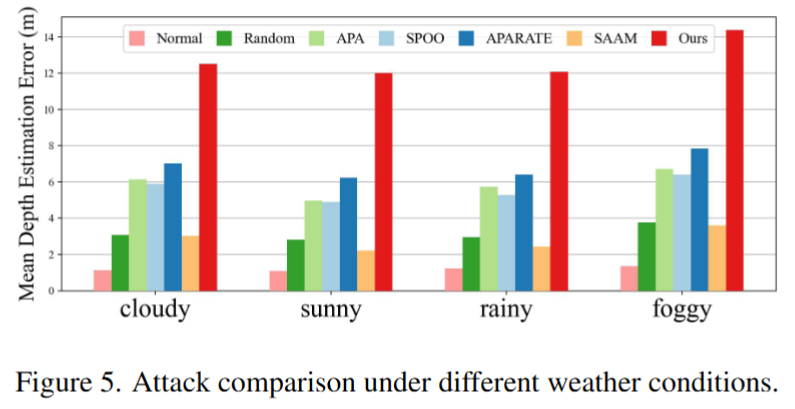

- 악천후 조건에 대한 저항성을 평가하기 위해, 우리는 Carla에서 여러 날씨 조건에서 실험을 수행했다. 자율 주행 시나리오의 맥락에서, 본 논문의 연구진들은 흐림, 맑음, 비, 안개라는 네 가지 일반적인 날씨 조건을 선택했다. 흐린 날씨 조건은 충분하고 적절한 조명이 있는 정상적인 날씨 조건을 나타낸다. 아래 Figure 5는 다양한 날씨 조건이 공격에 미치는 영향을 보여준다.

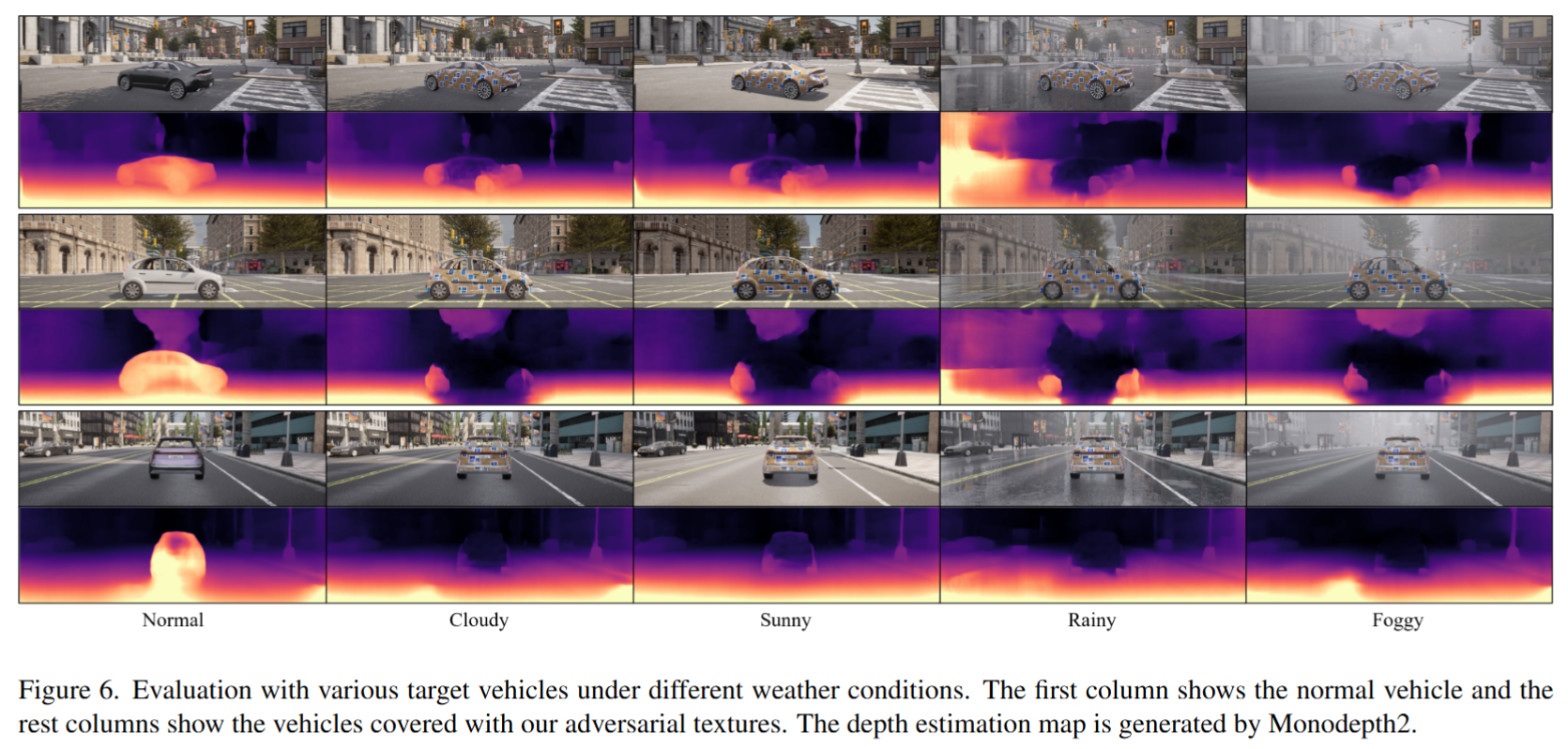

본 논문이 제안한 방법은 양호한 날씨 조건과 악천후 조건 모두에서 이전 연구에 비해 우수한 성능을 보여준다. 이전 공격은 기준이 되는 흐린 날씨 조건에 비해 맑고 비오는 날씨 조건에서 성능 저하를 보인다. 예를 들어, APA는 맑은 날씨와 비오는 날씨에서 각각 19.1%와 6.7%의 감소를 경험한다. 대조적으로, 본 논문이 제안한 공격 방법은 비교적 미미한 감소를 보여 3.9%와 3.4%의 감소를 기록한다. - 아래 Figure 6은 네 가지 날씨 조건에서 세 종류의 차량에 대한 위장 텍스처의 공격 효과를 보여준다.

- 다양한 시야각과 거리에서, 본 논문의 방법은 좋은 공격 성능을 유지하며, 이는 변화하는 날씨 조건에 거의 영향을 받지 않고 MDE에 의한 목표 차량의 깊이 추정을 효과적으로 속일 수 있다. 극심한 밝기와 비가 공격에 미치는 부정적인 영향 외에도, 안개가 낀 날씨에서 공격이 예상치 않게 긍정적인 영향을 나타내는 흥미로운 관찰 결과가 나타난다. 이 현상은 Monodepth2의 고유한 취약성 때문입니다. 적대적 공격이 없는 경우에도, 모델 성능은 안개가 낀 날씨에서 영향을 받는다.

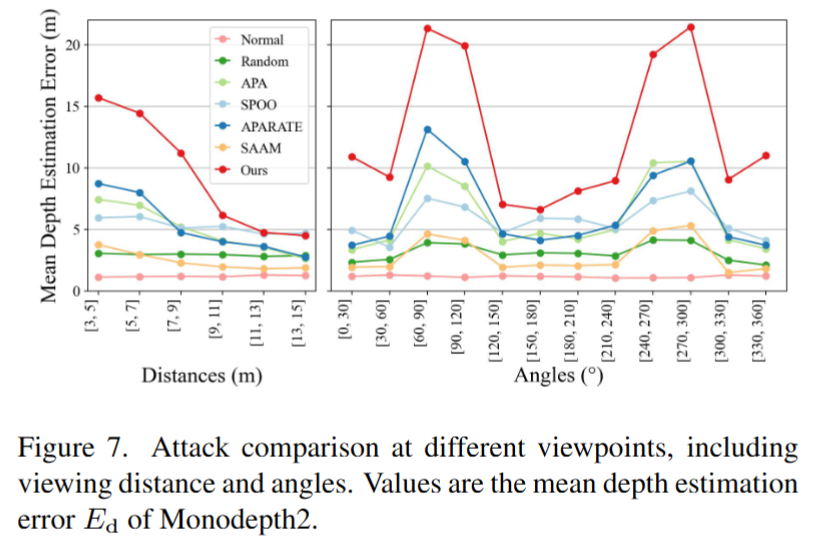

- 공격 견고성을 평가하기 위해, 본 논문의 연구진들은 목표 차량의 다양한 시점에서 카메라 위치를 무작위로 설정했다. 아래 Figure 7은 시청 거리와 각도를 포함하여 다양한 시점에서 Monodepth2의 평균 깊이 추정 오류와의 공격 비교를 보여준다.

- 본 논문의 공격은 이전 방법보다 모든 관찰 각도와 거리에서 더 나은 공격 성능을 보인다. 60-120◦ 및 230-300◦ 범위에서, 본 논문의 공격이 달성한 평균 깊이 추정 오차는 20m 이상이다. 60~120도 구간은 차량의 왼쪽 측면 근처를 카메라가 바라보는 각도이고, 230~300도 구간은 오른쪽 측면 근처를 의미한다. 차량의 측면은 앞면이나 뒷면보다 더 넓고 평평한 표면이 카메라에 노출된다.따라서 이 구간에서: 3D2Fool에서 생성한 적대적 텍스처가 차량 표면 전체에 걸쳐 넓게 적용되어, 카메라가 그 넓은 적대적 패턴을 잘 포착하게 되고, 이로 인해 MDE 모델이 깊이를 잘못 추정할 확률이 커진다. mean depth estimation error 식에서 분모도 커지긴 하지만, 분자가 훨씬 더 많이 커진다. 특정 시야각에서는 적대적 텍스처의 작은 커버리지 영역과 대상 차량의 과도하게 경사진 표면 때문에 공격 효과가 영향을 받는다. 대부분의 방법은 9m 이내에서 좋은 공격 효과를 보이며, 거리가 증가함에 따라 공격 성능이 점차 감소한다. 거리가 가까울수록 차량 표면의 세부적인 텍스처 변화나 왜곡이 카메라에 명확히 나타나기 때문에, adversarial 공격 효과가 크고 depth error가 커진다. 특히, SPOO의 성능은 다양한 거리에서 비교적 안정적이다. 이는 SPOO가 채택한 스타일 전이와 관련이 있다고 생각하며, 이는 전체 스타일 특징에 의한 적대적 공격의 섭동을 나타낸다. 스타일 전이는 텍스처 변화가 일정한 패턴이나 작은 영역이 아니라 이미지 전반의 시각적 특징을 포괄하는 형태라, patch가 보는 각도나 거리 변화에 상대적으로 덜 민감하다.

- 자율 주행 시나리오에서 흔히 볼 수 있는 다양한 객체에 적용했을 때 텍스처를 평가하기 위해, 본 논문의 연구진들은Monodepth2에 대해 동일한 파라미터와 텍스처 시드를 사용하여 트럭, 버스, 보행자를 처리한다. 아래 Table 2에서 볼 수 있듯이, 본 논문의 공격은 다양한 객체에서 다른 공격들을 능가하며, 이는 객체에 구애받지 않는 속성을 나타낸다.

아래 Figure 8에서 볼 수 있듯이, 버스와 보행자에 붙여진 적대적 텍스처는 Monodepth2의 깊이 예측에 심각한 영향을 미친다.

- 본 논문의 공격은 이전 방법보다 모든 관찰 각도와 거리에서 더 나은 공격 성능을 보인다. 60-120◦ 및 230-300◦ 범위에서, 본 논문의 공격이 달성한 평균 깊이 추정 오차는 20m 이상이다. 60~120도 구간은 차량의 왼쪽 측면 근처를 카메라가 바라보는 각도이고, 230~300도 구간은 오른쪽 측면 근처를 의미한다. 차량의 측면은 앞면이나 뒷면보다 더 넓고 평평한 표면이 카메라에 노출된다.따라서 이 구간에서: 3D2Fool에서 생성한 적대적 텍스처가 차량 표면 전체에 걸쳐 넓게 적용되어, 카메라가 그 넓은 적대적 패턴을 잘 포착하게 되고, 이로 인해 MDE 모델이 깊이를 잘못 추정할 확률이 커진다. mean depth estimation error 식에서 분모도 커지긴 하지만, 분자가 훨씬 더 많이 커진다. 특정 시야각에서는 적대적 텍스처의 작은 커버리지 영역과 대상 차량의 과도하게 경사진 표면 때문에 공격 효과가 영향을 받는다. 대부분의 방법은 9m 이내에서 좋은 공격 효과를 보이며, 거리가 증가함에 따라 공격 성능이 점차 감소한다. 거리가 가까울수록 차량 표면의 세부적인 텍스처 변화나 왜곡이 카메라에 명확히 나타나기 때문에, adversarial 공격 효과가 크고 depth error가 커진다. 특히, SPOO의 성능은 다양한 거리에서 비교적 안정적이다. 이는 SPOO가 채택한 스타일 전이와 관련이 있다고 생각하며, 이는 전체 스타일 특징에 의한 적대적 공격의 섭동을 나타낸다. 스타일 전이는 텍스처 변화가 일정한 패턴이나 작은 영역이 아니라 이미지 전반의 시각적 특징을 포괄하는 형태라, patch가 보는 각도나 거리 변화에 상대적으로 덜 민감하다.

- 악천후 조건에 대한 저항성을 평가하기 위해, 우리는 Carla에서 여러 날씨 조건에서 실험을 수행했다. 자율 주행 시나리오의 맥락에서, 본 논문의 연구진들은 흐림, 맑음, 비, 안개라는 네 가지 일반적인 날씨 조건을 선택했다. 흐린 날씨 조건은 충분하고 적절한 조명이 있는 정상적인 날씨 조건을 나타낸다. 아래 Figure 5는 다양한 날씨 조건이 공격에 미치는 영향을 보여준다.

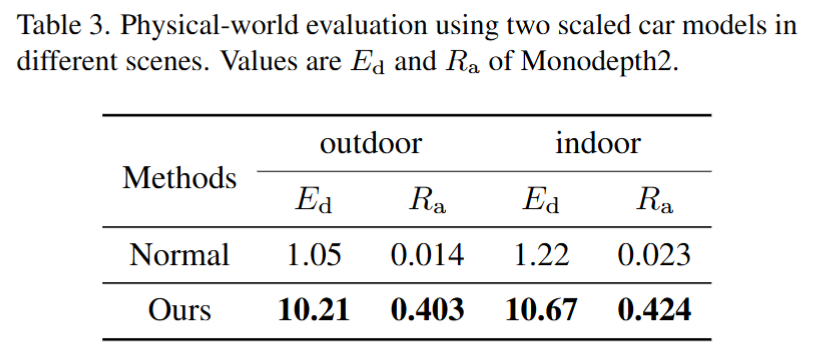

- Attack in the Real World

- 실제 세계 공격에 대해서는, 생성된 적대적 텍스처의 실제적인 효과를 검증하기 위해 여러 실험을 수행한다. 구체적으로, 우리는 1:24 스케일의 Tesla Model Y 자동차(모형)에 본 논문의 적대적 텍스처를 인쇄하여 붙이고, 다양한 배경 및 조명 조건 하에 배치한다. Redmi K60 휴대폰을 사용하여 다양한 환경 조건(예: 방향, 각도, 거리 및 주변 환경)에서 총 300개의 이미지를 수집한다. 아래 Figure 9는 자동차의 일반적인 외형의 깊이를 MDE 모델로 정확하게 추정할 수 있음을 보여준다.

대조적으로, 적대적 텍스처가 있는 자동차는 MDE 모델을 성공적으로 속여 텍스처 커버리지가 없는 영역까지 확장되었다. 평가 결과, Monodepth2에 대한 실제 공격 결과가 아래 Table 3에 제시되어 있으며, 이는 우리의 적대적 텍스처가 실제 환경에서도 성공적으로 적대적 공격을 수행할 수 있음을 보여준다.

- 실제 세계 공격에 대해서는, 생성된 적대적 텍스처의 실제적인 효과를 검증하기 위해 여러 실험을 수행한다. 구체적으로, 우리는 1:24 스케일의 Tesla Model Y 자동차(모형)에 본 논문의 적대적 텍스처를 인쇄하여 붙이고, 다양한 배경 및 조명 조건 하에 배치한다. Redmi K60 휴대폰을 사용하여 다양한 환경 조건(예: 방향, 각도, 거리 및 주변 환경)에서 총 300개의 이미지를 수집한다. 아래 Figure 9는 자동차의 일반적인 외형의 깊이를 MDE 모델로 정확하게 추정할 수 있음을 보여준다.

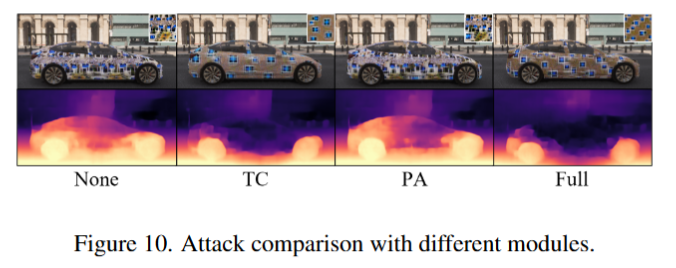

4.3. Ablation Study

각 구성 요소가 어떻게 기여하는지 평가하기 위해 기본 매개변수를 사용한 ablation study 를 통해 제안된 모듈과 loss function 항목을 조사한다. 본 논문의 연구진들은 Monodepth2를 공격하고 차량을 target 객체로 사용하여 Ed와 Ra를 report한다. 아래 Table 4의 결과는 제안된 두 변환 모듈이 공격 성능을 향상시키는 데 핵심적인 역할을 한다는 것을 확인한다. 또한 손실 함수의 다양한 조합의 결과를 보여준다. 최상의 성능은 적대적 손실과 smoothness loss의 조합을 사용하여 달성된다. 그러나 예상대로 NPS loss를 추가하면 텍스처가 더욱 자연스러워지도록 추가적으로 제약하므로 공격 성능이 약간 감소한다.

두 모듈을 모두 사용하면 공격 성능이 7.67m에서 12.75m로 향상된다.

아래 Figure 10은 각 모듈 조합에서 텍스처 시드와 해당 공격 효과를 보여준다. 특히, 텍스처 변환(TC)을 적용한 후의 텍스처 시드는 불규칙한 패턴에서 보다 구조화되고 시각적으로 자연스러운 구성으로 상당한 변화를 보여준다.

5. Conclusion & Future Work

본 논문에서는 3D Depth Fool ($3D^2$ Fool)을 제안하고 차량, MDE 모델, 날씨 조건 및 관점을 포함한 다양한 시나리오에서 현재 최첨단 공격보다 우수한 성능을 검증한다. 특히, 스케일된 자동차 모델에 3D 적대적 텍스처를 인쇄하고 붙여 넣어 다양한 백도어 및 실내 배경과 조명 조건에서 물리적 세계에서 3D2Fool의 효과를 검증한다. 향후 연구에서는 텍스처 커버리지 영역이 제한된 특정 각도와 복잡한 모양의 자동차 모델과 같이 비교적 어려운 설정에서 $3D^2$ Fool을 더욱 개선할 것이다. 또한 실제 블랙박스 공격 시나리오에서 3D2Fool의 전이 가능성을 탐색할 것이다.